在边缘侧重新思考语音AI:基于DGX Spark的实用离线流水线

Arm CPU 和开源技术如何借助 faster-whisper 与 vLLM 实现实时、隐私保护的语音对话

By Odin Shen

1. 引言

基于云的AI占据了大多数关注焦点,但真正实现响应和隐私保护的交互则发生在边缘侧。本文将展示如何基于Arm架构的NVIDIA DGX Spark平台,构建一个完全离线、实时运行的语音助手系统。该系统集成了 faster-whisper 和 vLLM 等开源组件,在无需将数据发送到本地环境之外的情况下,实现低延迟、接近人类对话体验的交互。

立即开始,你可以在 Arm Learning Path 上找到本篇博客的完整实例以及逐步操作指南。

2. 技术挑战:对云的依赖困境

在许多企业环境中,技术人员需要快速访问内部文档或获得实时支持。然而,依赖云端API会带来三个关键瓶颈:

- 延迟:与云端API的往返通信会打断语音对话的自然节奏。

- 隐私:将敏感数据发送到外部服务器会带来合规风险,尤其是在涉及专有内容时。

- 成本与可控性:基于API的计费模式和使用限制,会限制系统的扩展能力以及针对特定行业需求的定制化能力。

3. 解决方案:异构的开源流水线

为了解决上述问题,我们在DGX Spark上设计了一套流水线,该平台基于Grace-Blackwell GB10架构构建。在该方案中,CPU被定位为一个主动的、以低延迟为优化目标的计算引擎。

软件栈:为了实现最大的灵活性与性能,整个系统运行在以下开源工具上:

| 组件 | 软件/模型 | 功能说明 | 许可证/访问方式 |

|---|---|---|---|

| 音频采集 | PyAudio | 实时16kHz麦克风音频流 | MIT许可证 |

| 语音检测 | WebRTC VAD | 基于30毫秒帧的语音/静音检测 | BSD风格许可证 |

| 语音转文本 | faster-whisper | 在Arm CPU上高效、高质量的语音转录 | MIT许可证 |

| 推理引擎 | vLLM | 支持量化模型的GPU加速大模型服务 | Apache 2.0许可证 |

| 语言模型 | Mistral-7B-Instruct / Llama-3-70B (GPTQ) | 本地推理与自然语言响应 | HF模型许可证/模型卡条款 |

4. 关键组件与系统设计

4.1 实时音频与语音活动检测

系统以16kHz单声道音频进行采集,并使用WebRTC的语音活动检测(VAD)在30毫秒的帧级别上检测语音信号。该方法能够确保系统只处理有效的语音输入,同时忽略背景噪声和静音间隔。

4.2 基于Arm架构CPU的高速语音转写

对于短时、对延迟敏感的任务,系统并未将其分流到GPU上,而是使用高性能的Arm CPU集群(Arm Cortex-X 和 Cortex-A 系列核心)来处理。

- 为什么选择Arm:Arm架构针对实时搜索、小批量推理任务等低延迟关键型工作负载进行了优化。

- 性能表现:在Arm CPU上运行 faster-whisper 可以满足低延迟需求,在交互式系统中,语音转写时间约为70至90毫秒。

4.3 基于GPU加速的推理(vLLM)

在完成语音转写后,文本会被传递至vLLM进行处理。DGX Spark采用统一内存(Unified Memory)架构,使CPU与GPU共享同一内存空间。该设计允许GPU直接访问CPU的输出数据,从而无需显式的数据传输或通过PCIe进行拷贝所带来的额外开销。

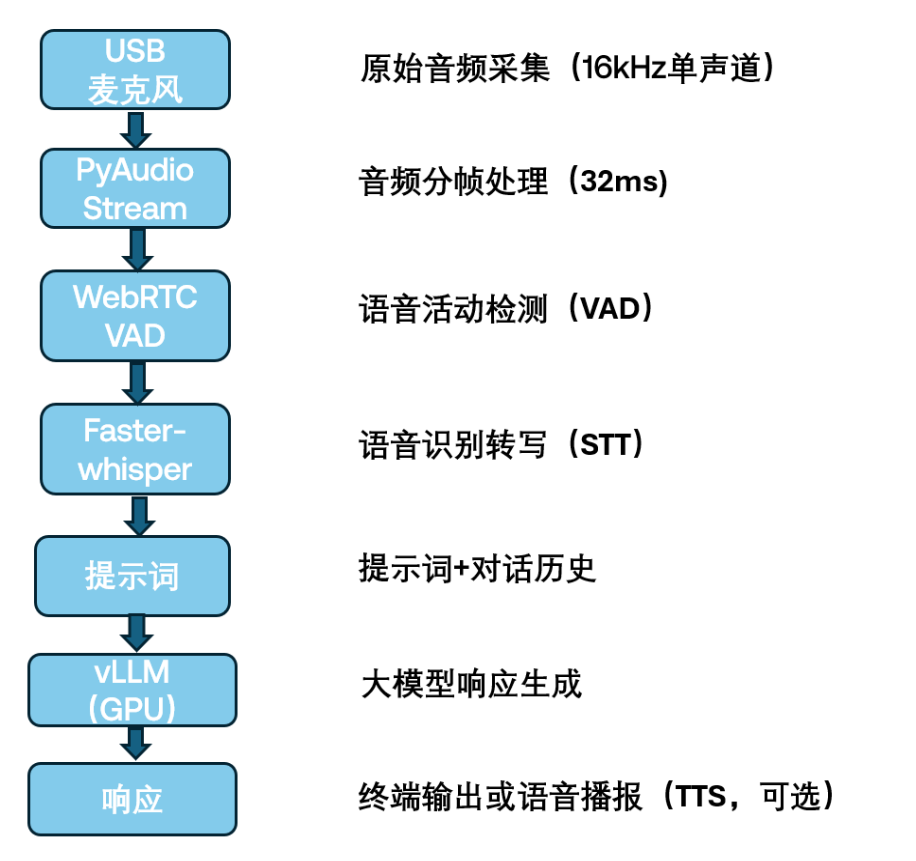

5. 系统架构流程图

该流程图展示了在DGX Spark上构建的一个高性能异构流水线。系统将任务分配给最合适的计算单元,以降低整体延迟。

在该流水线中,Arm Cortex-X 和 Cortex-A 系列CPU核心用于处理对延迟敏感的任务,例如音频采集和语音转写。这种方式可以实现低于100毫秒的响应时间。系统采用统一内存架构,使GPU能够直接访问共享DRAM中的转写数据,从而消除了传统PCIe数据传输带来的开销。整个流程的最后,由NVIDIA GPU运行vLLM引擎生成智能响应,从而实现高吞吐量且具备隐私保护的对话体验。

图1:DGX Spark异构流水线。Arm CPU负责语音转写(STT),GPU负责生成响应,从而显著降低交互延迟。

6. 演示:本地语音交互与性能指标

我们通过一个多轮"订阅取消"场景对系统进行了验证。系统能够生成经过验证、基于事实的回答,并且未出现幻觉(hallucination)问题。

性能指标:延迟拆解

以下数据记录了从用户语音结束到大模型开始生成响应之间的精确时间(即响应延迟)。

| 对话轮次 | 语音结束时间 | vLLM响应开始时间 | 响应延迟(秒) |

|---|---|---|---|

| 第一轮 | 00:10 | 00:13 | 3秒 |

| 第二轮 | 00:24 | 00:28 | 4秒 |

| 第三轮 | 00:41 | 00:45 | 4秒 |

| 第四轮 | 00:54 | 00:59 | 5秒 |

观察结果:所有对话轮次的平均响应延迟约为4秒。该性能表现可与基于云的解决方案相媲美,同时在无需网络连接的情况下提供了更强的隐私保护。

7. 准备构建你自己的系统?

我们认为,理解Arm架构AI能力的最佳方式是亲自实践。为此,我们准备了一套完整的、循序渐进的学习路径,帮助你部署这一流水线。

本教程将指导你完成以下内容:

- 为边缘设备配置专业级麦克风采集系统。

- 针对Arm Cortex-X架构优化 faster-whisper。

- 使用量化模型部署vLLM,以最大化本地吞吐性能。

教程链接:https://learn.arm.com/learning-paths/laptops-and-desktops/dgx_spark_voicechatbot

By Odin Shen

Re-use is only permitted for informational and non-commercial or personal use only.